Cada año se aplican cientos de actualizaciones en los algoritmos de Google, todas ellas basadas en las Directrices para la Clasificación de la Calidad de la Búsqueda e implementada para mejorar de una u otra manera los resultados de búsqueda que obtenemos los usuarios al hacer una consulta.

Sin embargo, entre la gran cantidad de modificaciones que Google ha hecho en sus algoritmos destacan unas pocas que son tremendamente importantes, y en este artículo quiero hablarte de Google BERT, una actualización anunciada por Pandu Nayak (vicepresidente de Google Search) el 25 de octubre de 2019.

Por ahora, en este artículo te daré un pequeño adelanto sobre algunos aspectos clave para entender qué es BERT, cómo funciona en los algoritmos de Google Search y cómo impacta en las SERP y en las estrategias SEO. ¿Comenzamos?

¿Qué es Google BERT y cómo funciona en los algoritmos de Google?

BERT es el acrónimo para Bidirectional Encoder Representations from Transformers (Representaciones de Codificador Bidireccional de Transformadores). Técnicamente, BERT es un modelo de Redes Neuronales Artificiales (RNA) aplicado al campo del Natural Language Processing (NLP), específicamente al subcampo del Natural Language Understanding (NLU).

En otras palabras, BERT es un un sistema basado en inteligencia artificial (IA) para ayudar a los algoritmos de Google en el procesamiento del lenguaje natural, es decir, a entender mejor el lenguaje que utilizamos los usuarios en el momento de realizar una búsqueda mediante oraciones,

En este sentido, la nueva actualización en los algoritmos de Google es tan innovadora como la realizada en 2015 con RankBrain, el primer mecanismo de IA utilizado para analizar las consultas de búsqueda de los usuarios y clasificar mejor los resultados en las SERP. Ambos sistemas, BERT en mayor medida, aplican un método de análisis que permite contextualizar de forma más natural cada consulta.

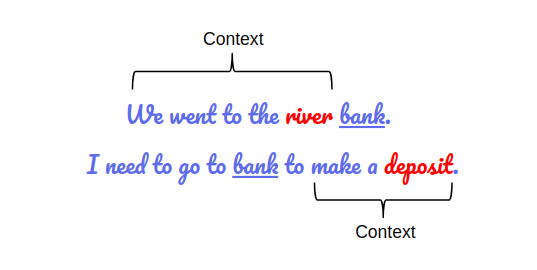

Para lograrlo, BERT posee una característica que se llama 'bidireccionalidad', que consiste en analizar una oración en dos direcciones. Es decir, analiza las palabras que se encuentran tanto a la izquierda como a la derecha de una palabra clave, y esto le permite entender en profundidad el contexto y la temática de toda la frase que introduce un usuario para la búsqueda en Google.

Fuente: Analytics Vidhya

Fuente: Analytics Vidhya

De esta manera, después de comprender muy bien de qué trata determinada consulta, los algoritmos de Google, gracias a sus más de 200 factores de clasificación, seleccionan aquellos contenidos que mejor responden a esa búsqueda, con lo cual los resultados en las SERP se vuelven cada vez más relevantes para los usuarios.

Por tanto, aunque BERT no es propiamente un factor de clasificación, sí que está relacionado de forma directa con varios de ellos, ya que este sistema comenzará a ser el encargado de decir a los algoritmos qué es exactamente lo que los usuarios necesitan encontrar.

¿De qué manera BERT afecta a las SERP de Google Search?

Según el equipo oficial de Google Search, el objetivo de la plataforma es darles rápidamente a los usuarios las respuestas exactas que ellos necesitan. Para ello, los algoritmos de clasificación de contenidos evolucionan cada día. Sin embargo, no solo la clasificación de las páginas indexadas es importante, sino también la comprensión lingüística de las consultas realizadas. En este último punto es donde entra BERT.

Gracias al análisis de BERT sobre las consultas, las páginas de resultados de Google se adaptan mucho mejor a los intereses de los usuarios. Esto significa que las “palabras clave o keywords” dejan de tener tanta relevancia como elementos individuales, pues de ahora en adelante Google da mayor prioridad a las intenciones de búsqueda en vez de a palabras que, por sí solas, están descontextualizadas y no logran transmitir una duda en concreto.

Este nuevo proceso de Google Search irá perfeccionando poco a poco la generación de fragmentos destacados y del fenómeno zero click en las SERP, ya que, por un lado, los fragmentos destacados son capaces de arrojar un resultado que responda de manera muy directa a una intención de búsqueda. Esto, a su vez, produce lo que se conoce como “zero click”, lo cual se refiere a que los usuarios, después de realizar una búsqueda, ya no necesitan hacer ningún otro clic para entrar a una página que responda a su consulta, pues dicha respuesta ya la pueden ver de forma directa en la SERP.

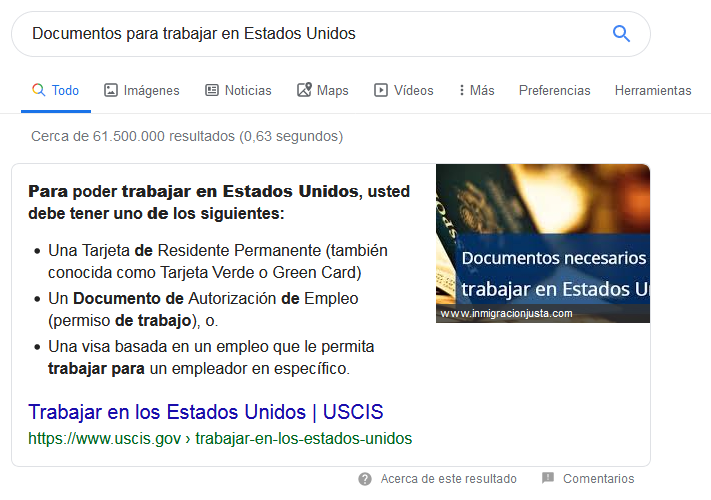

Un ejemplo de fragmentos destacados y de zero click es el siguiente:

Así, ante la consulta “Documentos para trabajar en Estados Unidos”, en la SERP aparece un fragmento destacado donde se muestra de forma inmediata una respuesta directa, y sin necesidad de que el usuario realice clic sobre alguna página.

Así, ante la consulta “Documentos para trabajar en Estados Unidos”, en la SERP aparece un fragmento destacado donde se muestra de forma inmediata una respuesta directa, y sin necesidad de que el usuario realice clic sobre alguna página.

Si bien es cierto que el funcionamiento de los fragmentos destacados es anterior a BERT, también es cierto que con esta nueva actualización los fragmentos generados comenzarán a ser mucho más eficientes, precisos y aplicables para mayor cantidad de consultas.

¿Cómo mejorar el SEO ante Google BERT?

Otra de las innovaciones que caracteriza a BERT es una propiedad que se llama 'Transformers' (Transformadores). Esta consiste en un mecanismo de asignación de puntajes que permite identificar cuál es la acepción más correcta de una palabra dentro de una frase en particular (en el caso de las palabras que tienen varias acepciones). Estos puntajes los asigna al analizar, de forma bidireccional, las palabras ubicadas a la izquierda y a la derecha de cada uno de los términos.

En este sentido, Pandu Nayak afirma lo siguiente sobre el algoritmo:

"Todavía queda mucho trabajo por delante. Por ejemplo, la palabra 'bajo' significa muchas cosas (puede ser un adjetivo o un instrumento musical). Hay muchos significados para una sola palabra. Por eso es vital que se entienda el contexto para poder entender el significado preciso del término".

Gracias a este proceso, BERT puede establecer una relación semántica muy potente entre todos los elementos de una oración, detectando, así, de forma bastante efectiva, la intención de búsqueda de los usuarios.

Como vemos, a BERT no se le escapa nada, ni siquiera las preposiciones. Antes de BERT, las preposiciones en una consulta eran ignoradas por los algoritmos y arrojaban resultados que no se adaptaban muy bien a las necesidades de los usuarios.

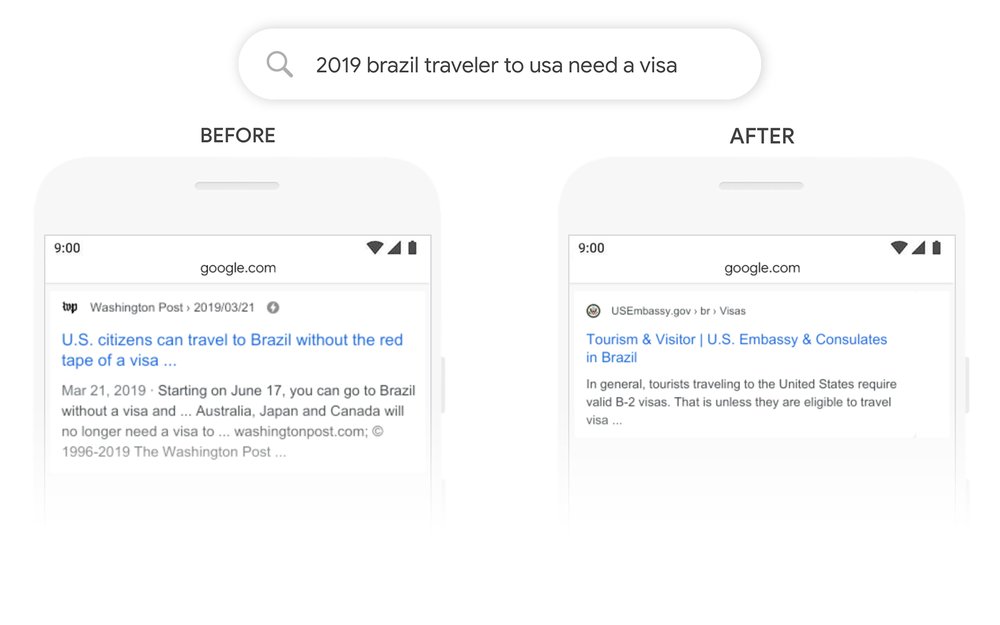

Veamos un ejemplo de ello:

Fuente: Blog de Google

Fuente: Blog de Google

Antes de BERT, la preposición “to” en la frase “2019 Brazil traveler to USA need a visa” no era tenida en cuenta por el algoritmo. Debido a esto, el primer resultado en la SERP respondía a una intención de búsqueda sobre que “los ciudadanos estadounidenses puedan viajar a Brasil sin un visado”.

Después de BERT, la preposición “to” es tenida en cuenta por el algoritmo, el cual le otorga bastante valor como un elemento determinante para entender la verdadera intención de búsqueda. Gracias a ello, el nuevo resultado en la SERP sí se adapta a la consulta sobre “los viajeros brasileños que quieren viajar a EE. UU. y desean obtener información sobre el visado”.

Teniendo en cuenta esta información clave, y aunque BERT no sea un factor de clasificación, sí que podemos aplicar ciertos cambios en la manera de redactar los contenidos con el objetivo de posicionarnos mejor en Google.

En nuestro ebook BERT para profesionales: ¿por qué está revolucionando el SEO?explicamos con más profundidad qué puedes hacer respecto al SEO para sacar el máximo provecho de esta actualización de Google.

Sin embargo, en líneas generales, la principal recomendación es que empieces a crear contenidos mucho más conversacionales, como si hablaras a tus lectores cara a cara. No te obsesiones por las keywords tan estrictas del Keyword Planner. A veces vemos artículos que, por mantener intacta una palabra clave, carecen de toda la naturalidad humana que dan las preposiciones, los conectores y demás elementos lingüísticos.

Con BERT, Google Search está valorando cada vez más aquellos contenidos que de verdad se preocupan por responder de forma natural las consultas de los usuarios. Así, el SEO quizás pronto pase a segundo plano como “optimización para buscadores” y debamos empezar a aplicar la “optimización para humanos”.

¿Qué encontrarás en nuestra guía descargable gratis sobre Google BERT?

Si te interesa profundizar en este tema, te recomiendo descargarte el ebook gratuito sobre BERT, donde damos respuesta a algunas preguntas como:

- ¿Qué es BERT y qué significan cada una de sus siglas a nivel práctico?

- ¿Cómo afecta el modelo BERT al SEO y qué podemos hacer al respecto?

- ¿Por qué esta actualización es tan importante para los resultados de búsqueda?

- ¿Es BERT un aliado o un obstáculo para los profesionales del marketing?

- ¿Cuáles son algunos ejemplos de resultados de Google con la nueva actualización?

- ¿Cómo funciona el natural language processing (NLP) en BERT?

- ¿Qué modelos del lenguaje han existido antes de BERT?

- ¿Cuál es la relación de Python, PyTorch y TensorFlow con Google BERT?

- ¿Son ALBERT o ‘Lite BERT’ y RoBERTa sucesores de esta actualización?

- ¿Cómo ha sido el preentrenamiento del modelo según el BERT paper?

- ¿La nueva modificación del algoritmo funciona en español?

Tanto si eres un profesional del marketing digital como un blogger, desarrollador o especialista en IT, nuestro ebook te resolverá muchas dudas en cuanto a marketing y en cuanto a aspectos técnicos avanzados.

Si te dedicas al SEO, será importante para ti terminar de leer este artículo. Si te dedicas a la programación, te invitamos, además, a acceder al GitHub de BERT para conocer todos sus recursos técnicos.

Ahora, cuéntanos: ¿qué opinas sobre esta nueva actualización de Google? Nos gustaría conocer si ya sabes cómo utilizarla tu favor, ¡déjanos tu opinión en los comentarios!

Publicado originalmente el 20 de noviembre de 2019, actualizado el 21 de junio de 2022.

Revisado y validado por Oriol Bel, Marketing Director en InboundCycle.